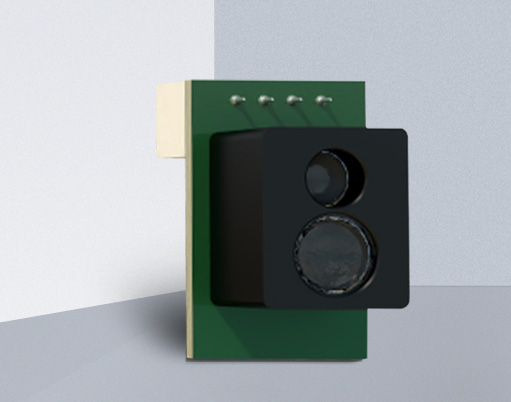

KNW-VEQ-110 3D面阵相机

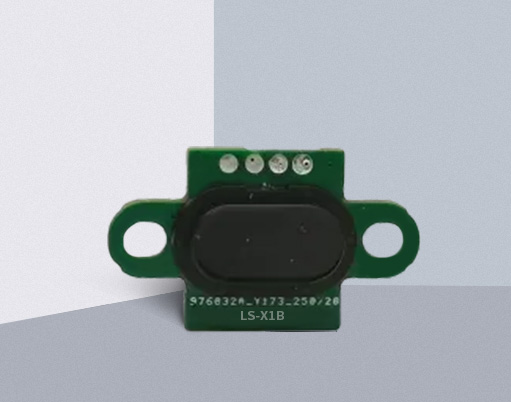

KNW-VEQ-110 3D面阵相机  KNW-VEQ-50 3D面阵相机

KNW-VEQ-50 3D面阵相机  KNW-VEQ-210 3D面阵相机

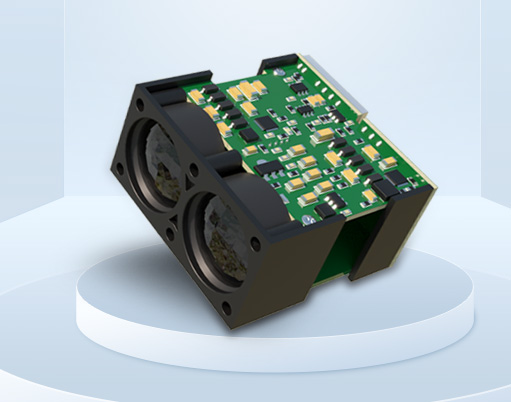

KNW-VEQ-210 3D面阵相机  KNW-VEQ-420 3D面阵相机

KNW-VEQ-420 3D面阵相机  KNW-VEQ-S2015A 3D面阵相机

KNW-VEQ-S2015A 3D面阵相机  KNW-VEQ-S2060A 3D面阵相机

KNW-VEQ-S2060A 3D面阵相机  KNW-S5030B 3D面阵相机

KNW-S5030B 3D面阵相机  KNW-VEQ-S5036A 3D面阵相机

KNW-VEQ-S5036A 3D面阵相机  KNW-VEQ-S5050A 3D面阵相机

KNW-VEQ-S5050A 3D面阵相机  KNW-VEQ-S5100A 3D面阵相机

KNW-VEQ-S5100A 3D面阵相机  KNW-S5045B 3D面阵相机

KNW-S5045B 3D面阵相机  KNW-S5090B 3D面阵相机

KNW-S5090B 3D面阵相机  KNW-S5135B 3D面阵相机

KNW-S5135B 3D面阵相机  KNW-S5585B 3D面阵相机

KNW-S5585B 3D面阵相机  KNW-VEQ-S5350A 3D面阵相机

KNW-VEQ-S5350A 3D面阵相机

嘿,大家好。今天想跟你们聊聊一个听起来有点高大上,但其实在我们生活中无处不在的东西——激光光传感器。别急着划走,我敢打赌,你每天用的手机、自动门、甚至扫地机器人里,都有它的影子。但很多人对它的理解可能还停留在“一种能感应光的玩意”这种模糊印象。那它到底是怎么工作的?又有哪些有趣的应用?咱们今天就来扒一扒它的“芯”里话。

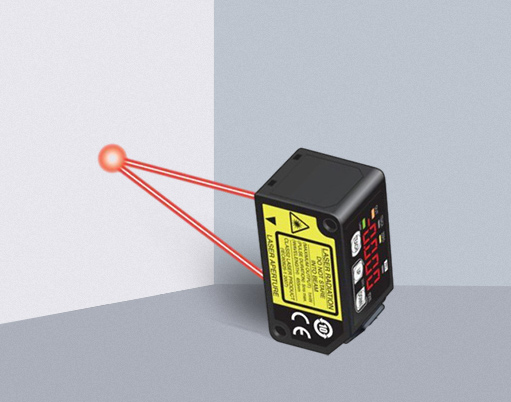

先说个冷知识:激光光传感器和普通的红外传感器、光敏电阻,其实有本质区别。普通传感器就像个“老花眼”,只能模糊地察觉有没有光,强度高不高;而激光光传感器,那是“鹰眼”级别的。它利用的是激光束的单色性、方向性和高亮度。简单说,就是发射出一束几乎不散射、波长单一、能量集中的光。这束光打到目标物上,反射回来,传感器接收,然后根据反射信号的强弱、时间差、相位变化等,就能精准地判断出物体的距离、形状、甚至表面材质。

举个例子,你见过那种自动感应水龙头吗?很多便宜的用的是红外反射,手伸过去就出水。但你有没有发现,有时候你穿一件黑衣服,或者手湿漉漉的,它反应就不灵敏了?这就是红外传感器的“软肋”——容易受环境光和物体表面特性影响。而换成激光光传感器,比如用905纳米波长的激光,它几乎不受环境光干扰,黑色物体也能稳稳检测。这就是为什么高端工业自动化设备、自动驾驶汽车上,用的都是激光雷达(LiDAR),而不是普通红外。

聊到这儿,可能有人会问:那它到底应用在哪些具体场景?我挑几个典型的说说。

第一个,工业制造里的“尺子”。在流水线上,需要精确测量零件的尺寸、厚度,甚至检测有没有划痕。激光三角测距法就是经典方案。传感器发射激光,镜头接收反射光,当物体位置变化时,反射光在传感器上的位置也会变。通过几何计算,精度能达到微米级。比如检测手机屏幕的平整度,或者电路板焊点的高度,都靠它。

第二个,自动驾驶的“眼睛”。这个大家应该不陌生。特斯拉之前主推摄像头方案,但后来也开始用激光雷达。为什么?因为激光雷达能直接生成三维点云,获取周围环境的精确距离信息。比如前方有个人影,摄像头可能判断错误,但激光雷达能直接告诉你“那里有个物体,距离3.2米”。在雨雾天气,激光雷达的穿透力也比纯视觉强。成本高是它目前的痛点,但技术迭代很快,未来可能成为标配。

第三个,医疗领域的“微创手术刀”。听起来很科幻?其实在眼科手术中,激光光传感器已经被用来精确控制激光切割的深度。比如做近视矫正的LASIK手术,传感器实时监测角膜厚度,确保激光只削掉需要的部分,不伤及深层。还有内窥镜里,用光纤传输激光,加上微小的传感器,能实现血管内的成像和诊断。

我知道,你们可能最关心的是:这东西贵不贵?我能不能自己玩?答案是,现在已经有不少消费级产品了。比如一些智能扫地机器人,会用到单线激光雷达来建图。价格也从以前的几千块降到几百块。如果你是个DIY爱好者,甚至可以买一个TOF(飞行时间)传感器模块,比如STM32配上VL53L0X芯片,自己做一个测距仪,成本不到50块钱。编程也不难,用Arduino或者树莓派,几行代码就能读数据。

我想分享一点个人感受。每次研究这些传感器,我都有种“技术即哲学”的感慨。激光光传感器,本质上是一种“用光丈量世界”的智慧。它不靠猜测,不靠经验,而是靠物理定律去获得最客观的数据。这让我想到,我们人类有时候太依赖直觉和感觉,而忽略了真实世界的精确反馈。或许,学会像传感器一样“去伪存真”,也是一种成长吧。

好了,今天的内容就到这里。如果你也对激光光传感器有什么实际应用或者DIY项目,欢迎在评论区聊聊。咱们下期见。